🏆 Champion Solution (Rank 1)

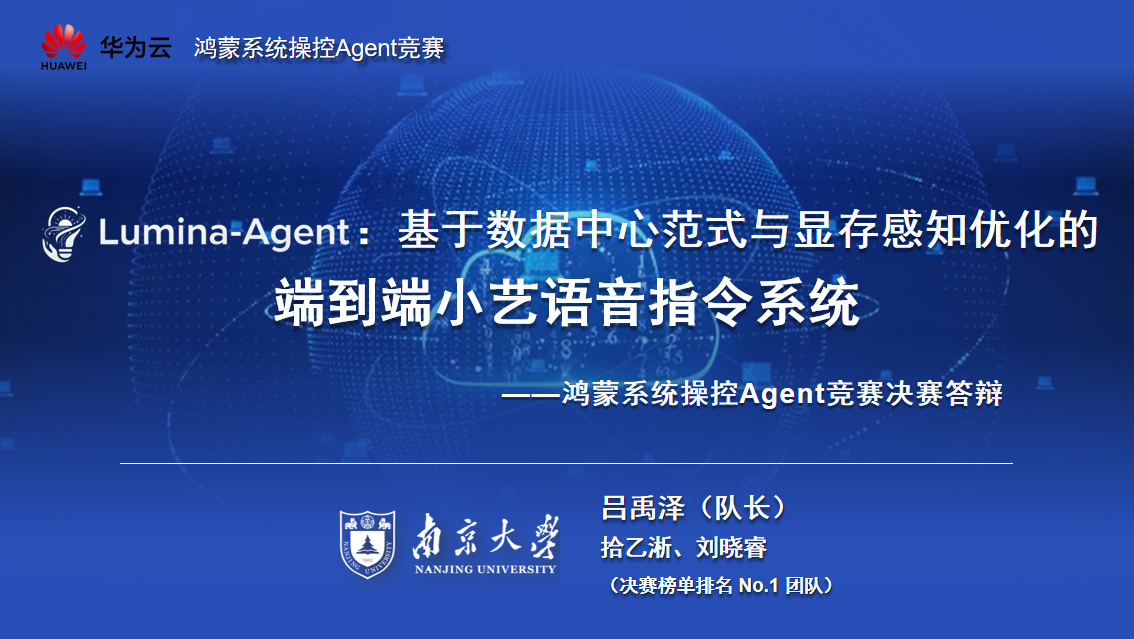

💡 Lumina-Agent

华为云·鸿蒙系统操控 Agent 竞赛冠军方案。基于数据中心范式与端到端显存感知优化的语音指令系统。

📖 项目简介

Lumina-Agent 是为了应对“华为鸿蒙系统操控 Agent 竞赛”中严格的资源限制(5GB NPU 显存)与复杂的多轮对话逻辑而设计的解决方案。我们摒弃了传统的 RAG 或复杂的分层架构,提出了一种极简主义、以数据为中心、针对 NPU 优化的端到端架构。

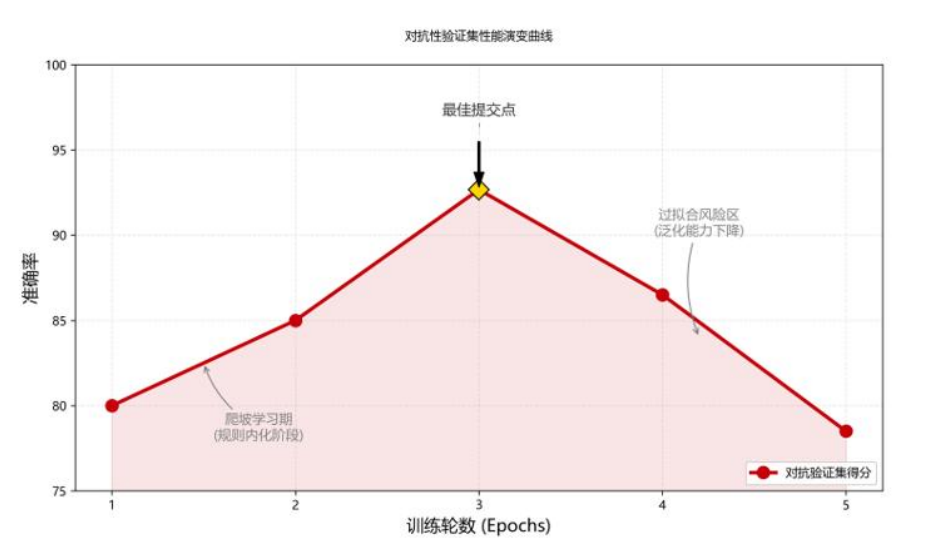

通过语义 Prompt 压缩、状态差分推理(State Differential Reasoning)以及混合专家(MoE)数据合成流水线,我们在仅使用 1.7B 参数模型的情况下,在本地冒烟测试集中达到了 100% 的准确率,并最终获得决赛冠军。

👥 核心开发团队

- 吕禹泽 (Lv Yuze): 队长;架构设计与算法优化

- 拾乙淅 (Shi Yixi): 数据工程与反幻觉设计

- 刘晓睿 (Liu Xiaorui): 系统部署与显存优化

🚀 核心创新 (Key Innovations)

🧠 扁平化端到端架构 (Flat-Direct)

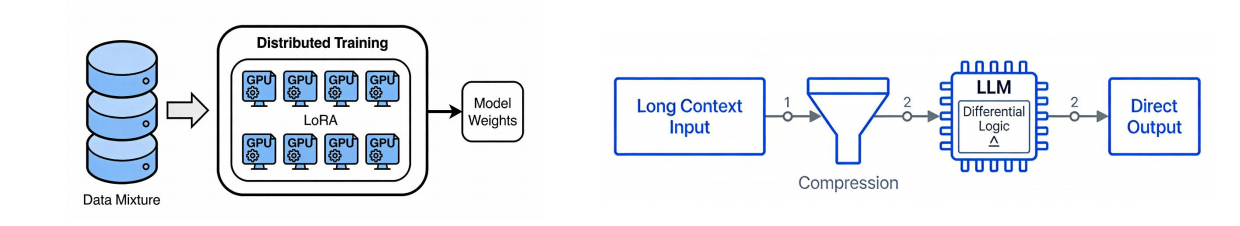

我们放弃了流行的分层架构,以避免双重推理延迟和错误级联。采用直接代理(Direct Agent)进行单遍推理,最大化了全局注意力可见性并最小化了延迟。

⚡ 显存感知压缩 (Memory-Aware Compression)

为了在 5GB NPU 显存限制下容纳 100+ 工具:采用语义蒸馏提取工具描述核心,截断 Enum 示例。将上下文长度从 20k 压缩至 5k token,推理速度提升 40%。

🏗️ 消费级显卡长文本训练

在 RTX 3090 (24GB) 上训练 6k 上下文模型:利用梯度检查点减少 60% 显存,全线性层 LoRA 微调增强逻辑能力,并采用全流程 BF16 精度对齐 NPU。

📊 MoE 数据合成流水线

构建了 20,000+ 样本数据集,包含“重采样层”、“逻辑层”(GPT-4 生成多轮逻辑)、“并发层”及清洗规则,有效解决了多指令场景和幻觉问题。

📈 竞赛成果

- 最终排名: 冠军 (Rank 1)

- 本地准确率: 100% (Smoke Test)

- 复杂逻辑准确率: >90%